本記事では、エンジニアがつくってきた“自分仕様のAIツール”や“AI活用術”をご紹介します。エージェントやBot、LLM連携ツールなど、実用的なものから、ちょっと遊び心のあるものまで。プロンプト設計やUIの工夫、うまくいかなかったことや思いがけない発見を通して、AIとの付き合い方をのぞいていきます。AIをどう使うかだけでなく、どんな距離感で付き合っているのか。誰かのAIとの向き合い方が、あなたとAIのちょうどいい“さじ加減”の手がかりに。

初めまして、kagayaです。

普段はAsterminds株式会社の共同創業者・CTOとして、エンタープライズ向けの定性調査を自動化するAIプロダクトを開発しています。

今回はリスナーが自分しかいない、自分専用のAIポッドキャストの話です。

移動中も有効活用するために、耳から情報を“聴く”メディアを欲していました。

それだけなら世の中に公開されているポッドキャストを聴けば良いはずです。

もちろん公開されているポッドキャストも多く聴いていて、それはそれで別の魅力があります。

ただ、特定の記事や情報を、自分好みのスタイルで聴きたいときがある。

自分専用ならリスナーは一人なので、自分にとって最高に都合のいい内容にできます。

これが思った以上に面白くて、使い方もつくり方もどんどん変わっていったので、今回はその話を書いてみます。

NotebookLMで十分、でも物足りなくなる

「自分専用ポッドキャスト」と聞いて、NotebookLMを思い浮かべた方は正しいです。

ドキュメントを放り込むだけで、二人の掛け合い形式のポッドキャストを自動生成してくれます。最初は自分もNotebookLMを使っていました。

ただ、しばらく使っていると物足りなくなってきます。

自分が日常的に追いかけている情報ソース——RSSフィードやXのリスト、GitHubの更新——を定期的に音声化したい。要約の粒度、トーン、尺を全部自分で決めたい。情報パイプラインに組み込みたい。

バイブコーディングがある今、NotebookLMがあったとしても自分で作ってみたくなるのがエンジニアの性ではないでしょうか。

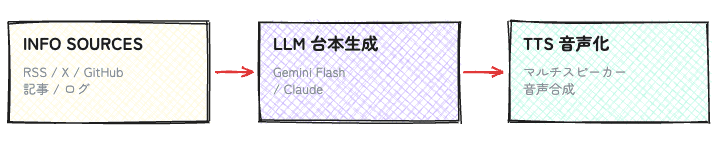

つくり方はシンプル

LLM台本生成

まず、LLMで台本を生成します。情報ソースをLLMに渡して、二人の掛け合い形式の台本をつくります。

GeminiとClaude、OpenAIを使い分けて、面白かったものを自動で採用する勝ち抜き戦を行うワークフローを組んでいます。

つくること自体は簡単ですが、難しいのは聴き続けられるものにすることです。「どの情報を拾うか」「どの粒度で要約するか」「どういうノリで話すか」をプロンプトで日々細かく修正しています。

たとえば「冒頭でフックを入れる」「3分ごとにトピックを切り替える」「一方が疑問を投げかけ、もう一方が答える形式にする」といった指示を入れるだけで、聴感が大きく変わります。

下記は実際に使っているプロンプトの一部です。

Convert the following article into a two-person podcast script in English.

Rules:

- Speakers are Alex and Sam

- Start with a hook ("Today we have something fascinating" etc.)

- At the end of each topic, add a one-liner on why it matters

- Include natural reactions and interjections

私は音声だとどうしても聞き流してしまう傾向にあったので、At the end of each topic, add a one-liner on why it mattersを追加して、トピックの切れ目で一言まとめを入れるようにしました。

そのおかげで聴いていてリズムが生まれたように感じています。

今回は割愛しますが、「台本の面白さ」を評価するというプロセスもあります。

これも中々に考えることがあり面白いのですが、「自分の好きなポッドキャストの台本」を言語化して、LLM as a Judgeをして、また改善サイクルを回して…というまさしくEvalを実践できます。

TTS音声化

次に、TTSで音声にします。私はGemini 2.5 Flash TTSを利用していますが、声の好みはモチベーションに直結するので、自分が心地よいと感じるものを選ぶのがおすすめです。

ボイスの組み合わせも重要で、同じ声質だと誰が話しているか分からなくなります。私には、低め・落ち着いた声と明るめ・テンポが速い声、対照的な声を組み合わせるのが合っていました。

もう一つの細かいこだわりとして、フィラーワードや間の設計があります。相槌や間が入ると妙に人間っぽく聞こえます。

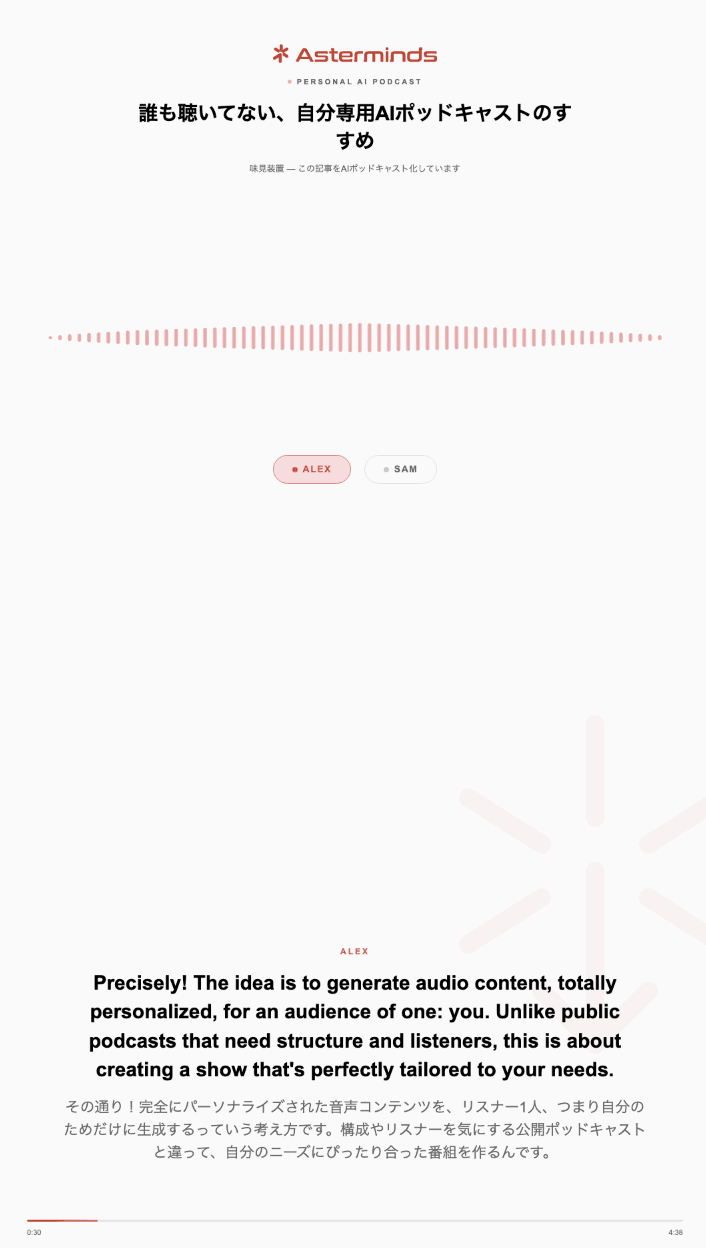

字幕動画化

ついでにRemotionとClaude Codeを組み合わせて動画化もしています。

RemotionはReactで動画をプログラマティックにつくれるフレームワークです。各フレームがReactコンポーネントで、CSSやTailwindがそのまま使えます。

Remotion自体は以前からあるツールですが、Agent Skillsとの組み合わせで格段に使いやすくなりました。

「字幕をもう少し大きく」「ビジュアライザーの色を話者で切り替えて」と会話するだけでレイアウトが変わっていく。コードを書いている感覚ではなく、動画を会話で編集している感覚です。

簡素なレイアウトではありますが、動画化したことで日英の字幕を表示できるようになりました。おかげで最近は英語学習の教材としても使っています。

使っていたら想定外の使い方が増えていった

最初は純粋に情報収集の効率化ツールでした。通勤中にAIニュースを聴ければいいなと。でも運用しているうちに、当初は想像もしていなかった使い方が出てきました。

Xタイムラインのラジオ化

忙しい日はXのタイムラインを追えません。でも、自分のリストやブックマークの内容をまとめて音声化しておけば、後から散歩中にキャッチアップできます。

「あなたがスマホを見なかった半日で、タイムラインではこんなことが話題になっていました」——みたいなブリーフィングが勝手に生成されている状態です。

ポイントは、全部を網羅する必要がないことです。自分専用なら「自分が気になりそうな話題だけ拾う」でいい。このフィルタリングの“さじ加減”をプロンプトで調整できるのが自作の強みです。

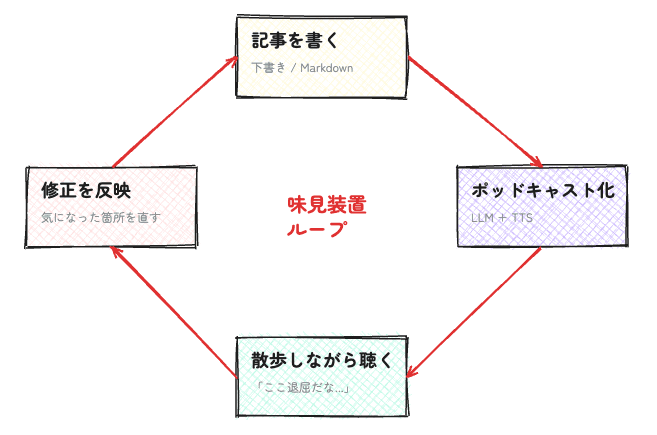

記事の味見装置

最初はまったく意図していなかった使い方です。

ブログ記事の下書きをAIポッドキャストにかけて聴いてみます。すると、目で読んでいるときには気づかなかったことに気づきます。

「この段落、聴いてると退屈だな」

「説明が回りくどい」

「この流れ、唐突だ」

文章を“読む”ときと“聴く”ときでは、引っかかるポイントが全然違います。

読むときは目が勝手に飛ばし読みしてくれますが、音声は線形に進みます。退屈な部分が容赦なく体感時間に反映されるんですよね。

もちろん記事をそのまま読み上げるのではなく、ポッドキャスト形式に変換しているので厳密な校正にはなりません。

ただ、「面白い記事であれば、紹介ポッドキャストとしても面白いはずだ!」という無理やりな理論で運用しています。

書いたものをポッドキャスト化して、散歩しながら聴いて、「ここ面白くないな」と思ったところを帰ってから直す。今はこのサイクルが自分の文章の推敲ツールになっています。

tipsとして、味見用の音声は3〜5分がちょうどいいです。長いと集中力が持たないし、短すぎると構成の良し悪しが分からない。「これを3分で語れるか?」と考えること自体が、文章を引き締める効果があります。

週の振り返りポッドキャスト

自分の活動ログを食わせると、「今週のあなた」を第三者視点で語ってくれるポッドキャストが生成されます。

これが不思議な体験で、自分のことなのに「今週そんなにインフラ触ってたっけ」「こんなこと考えてたのか、忘れてた」みたいな発見があります。日々は目の前のタスクに集中しているので、俯瞰すると見えてくるパターンがあったりします。

手書きの振り返りだと、少なくとも私は書くのが面倒で続かないですが、ポッドキャスト形式なら聴くだけでいい。週末の散歩のお供にちょうどいいです。

最近は機会がないのですが、上長やチームへの進捗報告をポッドキャスト形式で共有するのも面白いかもしれません。

自分専用だから雑でいい、でも“さじ加減”はこだわる

大事なのは、自分専用だから雑でいいということです。音声がちょっと不自然でも、動画のレイアウトが微妙でも、情報が自分に届けばそれでいい。80点で十分です。

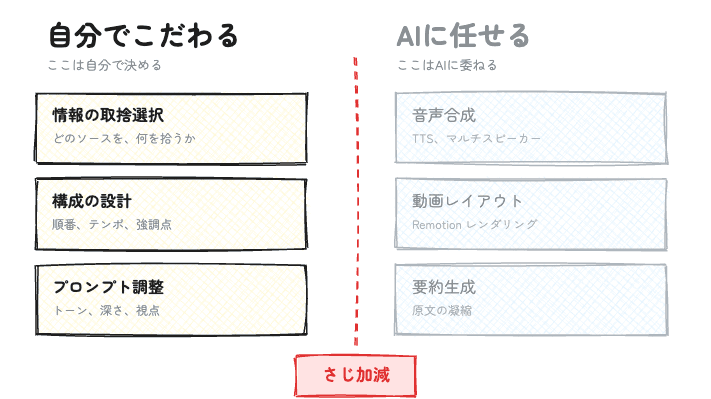

一方で、こだわるべきポイントもあります。

私は「どの情報を、どの粒度で、どういう順番で聴くか」の設計は、自分の情報摂取の癖に合わせて調整しています。

日常のワークフローに自然に載せることも重要です。たとえばSlackコマンドやCLIのスキルからワンアクションで生成できるようにしておくと、わざわざ作る感がなくなって習慣になります。このトリガーやインターフェースを自由に設計できるのが自作の良さです。

1つ気をつけていることがあります。AIに要約を任せすぎると、原文を読まなくなりがちです。

先ほどのプロンプトに入れた At the end of each topic, add a one-liner on why it matters は、実はこの対策でもあります。

各トピックの末尾に「なぜこれが重要か」の一言が入ることで、「あ、これは原文読みたい」と思えるフックになる。ポッドキャストは入り口であって、深い理解のためには原文に当たる。情報収集の幅を広げるフィルターになるようにしています。

このAIに任せる部分と自分でこだわる部分、そしてそれぞれで何を選択し、どう設計するか。これが本シリーズのテーマでもある“さじ加減”による各々のAI活用の面白い点ではないでしょうか。

おわりに

自分専用のツールをつくる行為そのものが、「AIとどう付き合うか」の実験になっています。どこまで任せるとちょうどいいのか。どこから先は自分の判断が必要なのか。

それを日常的に体感できるのが、自分のためのAIエージェント、AIツールをつくる隠れた価値だと思っています。

もし気になったら、まずはNotebookLMで自分の気になる記事をポッドキャストにしてみてください。物足りなくなったら、LLM+TTSで自分のパイプラインをつくってみる。Claude Codeで自動化して、Remotionで動画にもできます。

リスナーは自分一人。でも、自分にとって一番愛着が湧くポッドキャストになるかもしれません。